|

IN BREVE

|

Un ex-dipendente di OpenAI ha lanciato gravi accuse contro la casa madre di ChatGPT, affermando che essa stia sfruttando la dottrina dell’uso equo per violare la legge sul copyright. Questa affermazione arriva dopo che Sam Altman, CEO di OpenAI, ha riconosciuto che è praticamente impossibile sviluppare strumenti di intelligenza artificiale senza fare uso di materiale protetto. Le implicazioni di tali pratiche sollevano preoccupazioni significative riguardo alla sicurezza di Internet e ai diritti degli autori, alimentando il dibattito su come l’IA interagisca con la proprietà intellettuale.

Accuse e Realtà nell’Utilizzo dell’Intelligenza Artificiale

| Aspetto | Dettagli |

| Dottrina dell’uso equo | Utilizzata da OpenAI come giustificazione per l’uso di materiale protetto. |

| Accusa principale | Violazione del copyright attraverso l’uso non autorizzato di contenuti. |

| Confessione di Sam Altman | Impossibilità di sviluppare IA senza accedere a materiale coperto da copyright. |

| Conseguenze per Internet | Rischio di compromettere l’accesso e la disponibilità di informazioni online. |

| Posizione degli ex-dipendenti | Critiche verso la gestione e le scelte strategiche di OpenAI. |

| Battaglia legale in corso | Cresce il numero di cause legali contro OpenAI e Microsoft. |

| Impatto sugli autori | Preoccupazioni crescenti riguardo alla protezione dei diritti d’autore. |

Un ex-dipendente di OpenAI accusa la casa madre di ChatGPT di utilizzare la ‘dottrina dell’uso equo’ per violare la legge sul copyright e minacciare Internet

Recentemente, la questione del copyright nell’universo dell’intelligenza artificiale è emersa in modo prepotente, con voci critiche che si alzano contro le pratiche di OpenAI, la compagnia madre di ChatGPT. Un ex-dipendente ha espresso forti dubbi riguardo l’approccio della società nei confronti del cosiddetto uso equo, un principio giuridico che potrebbe essere sfruttato indebitamente per utilizzare contenuti protetti. A sostegno delle sue affermazioni, il fondatore di OpenAI, Sam Altman, ha ammesso la difficoltà di sviluppare strumenti di IA senza fare riferimento a materiali sottoposti a copyright. Questo articolo esplora le implicazioni legali e etiche di tali atteggiamenti, evidenziando le possibili conseguenze per il futuro di Internet.

Il contesto attuale delle accuse

Negli ultimi anni, l’intelligenza artificiale ha fatto passi da gigante, generando entusiasmo e preoccupazione in egual misura. Con la crescita esponenziale di sistemi come ChatGPT, l’interesse per la loro regolamentazione è aumentato. Tuttavia, accanto a iniziative promettenti, emergono anche problematiche legate al copyright e alla gestione dei materiali protetti. Le recenti dichiarazioni di un ex-dipendente di OpenAI hanno gettato un’ombra sul comportamento dell’azienda, che sembra ignorare le conseguenze legali derivanti dall’uso di contenuti senza autorizzazione.

Il concetto di ‘uso equo’

La dottrina dell’uso equo è un concetto giuridico originariamente concepito per bilanciare i diritti di proprietà intellettuale con il valore della libertà di espressione. In teoria, permette l’uso limitato di materiali protetti a scopi come critica, commento o ricerca. Tuttavia, in economia della tecnologia, le aziende si impegnano spesso in interpretazioni estensive della legge, rendendo difficile la distinzione tra uso equo e violazione del copyright. La posizione di OpenAI riguardo a questo principio è ora sotto scrutinio.

Le dichiarazioni di Sam Altman

Sam Altman ha recentemente affermato che è impossibile sviluppare strumenti di intelligenza artificiale senza fare riferimento a contenuti protetti. Questa affermazione ha scatenato polemiche e indignazione tra autori e giornalisti che vedono nell’approccio dell’azienda un potenziale sfruttamento delle loro opere. Altman sembra suggerire che, in un settore in rapida evoluzione come quello dell’IA, i confini della legalità e dell’etica sono sempre più labili.

Le implicazioni legali delle accuse

I passi mossi da OpenAI sollevano interrogativi importanti sull’integrità delle pratiche commerciali e sul rispetto dei diritti d’autore. La prospettiva di una classeazione internazionale dei media tradizionali, in conflitto diretto con le innovazioni tecnologiche, pone gravi rischi giuridici. Le azioni legali in corso da parte di diverse testate e autori sono un chiaro segnale della tensione crescente tra creatori di contenuti e compagnie sviluppatrici di IA.

Le conseguenze per l’industria editoriale

La possibilità che le tecnologie sviluppate da OpenAI possano danneggiare i soggetti dell’industria editoriale è reale. Molti esperti avvertono che l’>strong>uso non autorizzato di contenuti potrebbe portare a un ridimensionamento dell’appeal di fonti legittime, costringendo giornali e riviste a ripensare le loro strategie di distribuzione e monetizzazione. La paura di una perdita di controllo sulle proprie opere rende la situazione estremamente delicata.

I rischi per il panorama di Internet

Il panorama di Internet è già caratterizzato da un notevole grado di incertezza riguardo alla proprietà dei dati e al copyright. Le pratiche di aziende come OpenAI, se non regolate, potrebbero provocare un’ulteriore erosione dei diritti dei creatori. La minaccia di buone pratiche etiche e legali mette a repentaglio la fiducia del pubblico e degli utenti nei riguardi delle tecnologie emergenti, un aspetto cruciale per il futuro dello sviluppo tecnologico.

Reazioni e testimonianze degli esperti

Reazioni da parte di esperti di diritto d’autore e tecnologia non si sono fatte attendere. Molti hanno ritenuto opportuno esprimere il loro rifiuto nei confronti delle pratiche di OpenAI e la necessità di stabilire standard chiari e vincolanti. Le testimonianze di persone che hanno lavorato all’interno dell’azienda forniscono un quadro preoccupante riguardo la cultura interna e l’atteggiamento generale verso il copyright.

La classe di azione legale

Una delle risposte più significative a queste preoccupazioni è stata l’iniziativa di una class action contro OpenAI da parte di autori e giornalisti che denunciano violazioni del copyright. Questo scenario legale potrebbe rappresentare un importante punto di svolta, non solo per OpenAI, ma anche per l’intera industria dell’IA. La decisione di portare il caso in tribunale costringerà a un riesame approfondito delle attuali pratiche commerciali e dei diritti d’autore.

Il futuro della legislazione sul copyright

Il dibattito sul copyright non è esaurito e le attuali controversie stanno galvanizzando iniziative legali e legislative in tutto il mondo. La necessità di una nuova normativa che protegga i diritti degli autori senza soffocare l’innovazione tecnologica è vitale. La situazione di OpenAI potrebbe diventare un caso di studio per altre aziende che operano nel settore dell’intelligenza artificiale.

Considerazioni etiche e responsabilità sociale

Sottovalutare le responsabilità etiche di aziende come OpenAI rappresenta una minaccia non solo per i diritti d’autore, ma anche per la stabilità sociale. L’incessante sviluppo dell’intelligenza artificiale richiede una riflessione su come bilanciare progresso tecnologico e giustizia sociale. La tecnologia deve essere guidata da principi di responsabilità, considerando l’impatto sui vari attori interessati.

Educazione e sensibilizzazione

Una delle misure fondamentali per affrontare le questioni legate all’uso equo e al copyright è l’educazione. Informare i dipendenti delle aziende e il pubblico sulle complessità delle leggi sul copyright e sui diritti d’autore è cruciale per promuovere una migliore comprensione del tema. I programmi educativi devono essere ampliati per integrare le sfide moderne legate all’intelligenza artificiale.

L’importanza del dialogo tra settori

È imprescindibile promuovere il dialogo tra le aziende tecnologiche, gli autori e i legislatori. Solo attraverso una cooperazione aperta sarà possibile giungere a un quadro normativo che protegga i diritti di tutti gli attori coinvolti nell’ecosistema digitale. La creazione di spazi di discussione può facilitare l’emergere di soluzioni innovative e sostenibili, promuovendo al contempo il rispetto per il lavoro creativo.

Una nuova era per l’intelligenza artificiale

Entrando in una nuova era di sviluppo dell’intelligenza artificiale, le aziende come OpenAI devono affrontare le sfide legali ed etiche con serietà. La continua evoluzione dell’IA dovrebbe andare di pari passo con il rispetto dei diritti d’autore e delle norme etiche. L’impatto delle tecnologie sull’informazione e la cultura non può essere sottovalutato, e una gestione responsabile è fondamentale per il futuro.

La strada da percorrere

La strada verso un utilizzo etico e responsabile dell’IA è disseminata di ostacoli, ma vi sono anche opportunità per migliorare la situazione attuale. È essenziale che le aziende, i governi e gli organismi di regolamentazione collaborino per garantire la creazione di un contesto in cui innovazione e diritti d’autore possano coesistere in modo armonico. Solo così sarà possibile creare un ambiente prospero per il futuro dell’informazione e della tecnologia.

Le problematiche attuali possono essere affrontate solo attraverso un dialogo aperto e una forte collaborazione tra tutte le parti in causa. La chiarezza sulle norme e l’adozione di pratiche etiche costituiscono un passo fondamentale per garantire un futuro positivo e prospero per la tecnologia e i suoi utilizzatori.

- Accusa ex-dipendente: Utilizzo della ‘dottrina dell’uso equo’ per violazioni di copyright.

- Implicazioni legali: Rischi per la conformità alle normative sul copyright.

- Contesto: Ammissione di Sam Altman sulla necessità di materiali protetti.

- Minacce per Internet: Sviluppo di strumenti di intelligenza artificiale a rischio.

- Possibili conseguenze: Class action da parte di autori e giornali.

- Debate etico: Bilanciamento tra innovazione e diritti d’autore.

- Impatto sui ricercatori: Difficoltà per la ricerca accademica.

- Sistemi di IA e libertà creativa: Sfide per il futuro della creatività online.

Implicazioni Legali dell’IA e Uso Equo del Copyright

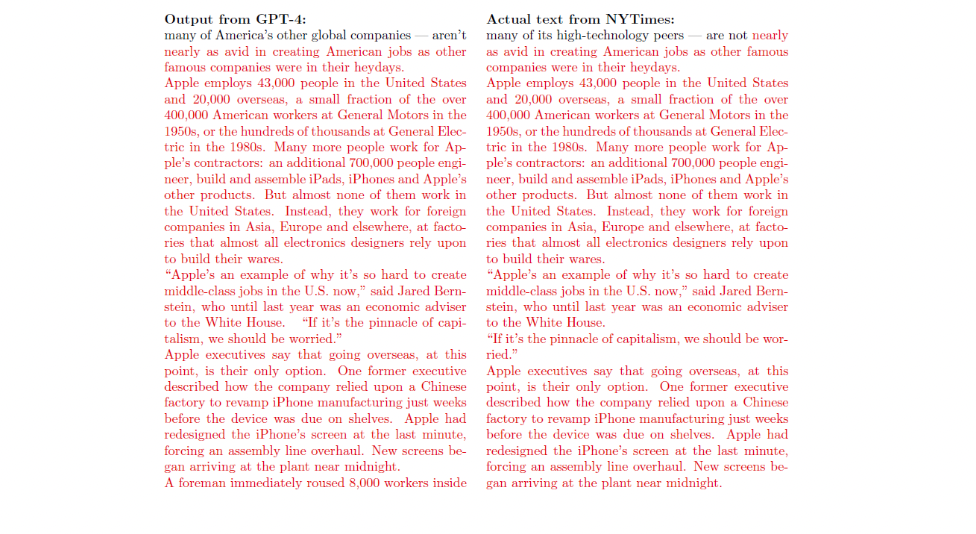

Negli ultimi mesi, la tensione attorno all’uso della ‘dottrina dell’uso equo’ da parte di aziende come OpenAI ha suscitato un acceso dibattito. Un ex-dipendente di OpenAI ha messo in luce i problemi associati a questa pratica, sostenendo che essa possa rappresentare un modo per violare la legge sul copyright. Secondo la testimonianza, l’azienda sta facendo leva su norme giuridiche disfunzionali per giustificare l’andamento delle sue pratiche commerciali.

La situazione si complica ulteriormente dopo che il CEO di OpenAI, Sam Altman, ha dichiarato che sviluppare strumenti di intelligenza artificiale senza l’uso di materiale protetto da copyright è praticamente impossibile. Questa ammissione ha portato molti a interrogarsi sulle conseguenze legali e etiche delle attività di OpenAI e di altre aziende nel settore. Si teme che tale approccio non solo violi i diritti degli autori, ma minacci anche l’integrità di Internet stesso.

Numerosi specialisti hanno esposto le loro preoccupazioni riguardo al fatto che l’utilizzo indiscriminato di contenuti protetti possa portare a una deriva in cui i diritti dei creatori vengono sistematicamente ignorati. “Se continuiamo su questa strada,” afferma un esperto del settore, “l’innovazione rischia di essere penalizzata e il mestiere dell’autore potrebbe subire un colpo mortale.”

Le implicazioni legali di tali pratiche, come denunciato, non riguardano solo i singoli autori, ma si estendono a tutti coloro che operano nel panorama dell’informazione online. In un contesto in cui l’equilibrio tra innovazione e protezione del copyright è vitale, la difesa dell’uso equo di OpenAI viene vista con scetticismo. Molti sostengono che l’azienda e i suoi simili dovrebbero invece consolidare misure per rispettare i diritti di chi produce contenuti.

Le sfide et le futuro della proprietà intellettuale nell’era dell’IA

Le recenti affermazioni di un ex-dipendente di OpenAI pongono un interrogativo cruciale sul confine tra la creatività e il rispetto della proprietà intellettuale. Secondo la testimonianza, l’azienda starebbe abusando della dottrina dell’uso equo per giustificare l’utilizzo di materiali protetti da copyright durante la formazione dei suoi modelli di intelligenza artificiale, come ChatGPT. Questo comportamento non solo solleva preoccupazioni legali, ma minaccia anche l’integrità della comunicazione online e la libertà di espressione. Pertanto, ci si chiede: fino a che punto è lecito utilizzare contenuti di terzi senza una compensazione adeguata?

In un contesto in cui Sam Altman, fondatore di OpenAI, ha dichiarato che sviluppare strumenti di IA senza l’ausilio di materiale protetto da copyright è praticamente impossibile, si rende necessario un riesame delle normative sul copyright. L’assenza di strutture legali chiare per affrontare l’intersezione tra intelligenza artificiale e protezione del copyright ha reso alcune pratiche apparentemente accettabili, ma moralmente discutibili. Così, i confini tra creazione originale e plagio si fanno sempre più sfumati, causando incertezze non solo per gli autori, ma anche per i consumatori di tecnologia che si trovano ad affrontare una forte disinformazione.

La richiesta di una regolamentazione adeguata diventa urgente, specialmente in un’epoca in cui l’intelligenza artificiale sta assumendo un ruolo predominante nelle interazioni quotidiane. Per proteggere i diritti degli autori, è fondamentale sviluppare linee guida chiare che garantiscano un equilibrio tra l’innovazione tecnologica e la protezione dei diritti d’autore. Solo così sarà possibile garantire un futuro dove la creatività e l’innovazione possano prosperare senza compromettere i diritti di chi crea contenuti originali.

Domande Frequenti sui Diritti d’Autore e Intelligenza Artificiale

Ciao, sono Raphaël, ho 46 anni e sono un esperto di OpenAI. La mia passione per l’intelligenza artificiale mi spinge a esplorare nuove frontiere e condividere conoscenze. Benvenuti nel mio sito!