OpenAI si trova al centro di un intenso dibattito riguardante la sicuurezza delle nuove tecnologie di intelligenza artificiale. Con il lancio della sua ultima versione, GPT-4, l’azienda ha riconosciuto i potenziali rischi e ha adottato una serie di misure per garantire la protezione dei dati e l’integrità dei sistemi. Interventi di sicurezza sono stati sviluppati sulla base di feedback forniti da esperti esterni, contribuendo a delineare politiche e procedure destinate a minimizzare i pericoli associati a un uso improprio. La struttura interna di OpenAI include un comitato per la sicurezza, dedicato a garantire che le strategie si evolvano in risposta all’ecosistema dinamico delle tecnologie di intelligenza artificiale. Con un focus sulla trasparenza e il rispetto delle normative vigenti, OpenAI si impegna a favorire un uso responsabile della sua piattaforma API, affinché si possano esplorare i benefici dell’AI evitando al contempo le insidie dell’era digitale.

|

IN BREVE

|

- Interventi di Sicurezza: OpenAI implementa misure di sicurezza basate su feedback di esperti esterni.

- Politiche di Utilizzo: Non compromettere la privacy degli utenti è una priorità fondamentale.

- Formazione Continua: L’addestramento della nuova intelligenza artificiale prevede una costante revisione delle misure di sicurezza.

- Governance Indipendente: Il comitato per la sicurezza opera in modo autonomo dal consiglio di amministrazione.

- Trasparenza dei Dati: OpenAI si impegna a garantire trasparenza nell’uso dei dati personali.

- Adeguamento Normativo: Conformità alle normative vigenti, come l’AI ACT, per garantire la sicurezza.

- Monitoraggio dei Rischi: Riconoscimento e gestione dei potenziali rischi nell’uso della tecnologia OpenAI.

- Innovazione Responsabile: Sviluppo della tecnologia con un occhio attento alle implicazioni etiche.

OpenAI si impegna a garantire la sicurezza della propria tecnologia attraverso una serie di politiche rigorose, interventi di sicurezza e l’implementazione di feedback ricevuti da esperti del settore. Questa dedizione si traduce in un approccio strategico per affrontare i rischi e promuovere la trasparenza nell’uso dei dati. Di seguito, esploreremo i vari meccanismi che OpenAI ha messo in atto per garantire un uso responsabile e sicuro della sua intelligenza artificiale.

Interventi di sicurezza basati su feedback esterni

OpenAI riconosce i potenziali rischi associati alla sua tecnologia, specialmente con il lancio di GPT-4. In risposta, ha adottato una serie di interventi di sicurezza che derivano da contributi di esperti esterni provenienti da diversi ambiti. Questi esperti forniscono indicazioni cruciali per migliorare le politiche di sicurezza, garantendo che i sistemi sviluppati non compromettano la privacy e la sicurezza degli utenti.

Politiche di utilizzo e trasparenza

Per garantire un uso sicuro delle proprie tecnologie, OpenAI ha elaborato dettagliate politiche di utilizzo disponibili online. Queste politiche definiscono comportamenti inaccettabili, come la violazione della privacy e l’uso improprio dei modelli di intelligenza artificiale. Inoltre, OpenAI è fortemente impegnata nella trasparenza riguardo l’uso dei dati personali, come dimostrato nei suoi rapporti con le autorità competenti.

Formazione continua e miglioramento

OpenAI non smette mai di addestrare i propri modelli, lavorando costantemente su nuovi algoritmi e miglioramenti. Durante questa fase di sviluppo, il comitato di sicurezza dell’azienda collabora attivamente per perfezionare le sue politiche e i suoi processi. Questo continuo lavoro di verifica e aggiornamento è essenziale per affrontare le nuove sfide e garantire la sicurezza nella creazione di intelligenza artificiale generale.

Indipendenza del comitato per la sicurezza

Un elemento chiave della strategia di OpenAI è l’istituzione di un comitato per la sicurezza che opera in modo indipendente dal consiglio di amministrazione. Questo organo ha identificato diverse aree chiave su cui focalizzarsi, inclusa la governance e il rafforzamento delle misure di protezione. Questa separazione è cruciale per garantire che le decisioni di sicurezza siano prese in modo obiettivo e trasparente.

Considerazioni legali e normative

Le tecnologie di OpenAI non solo puntano ad offrire innovazione, ma devono anche conformarsi a normative esistenti come l’AI ACT. L’aderenza a queste normative contribuisce a garantire una maggiore sicurezza dei dati e facilita la compliance, un aspetto essenziale in un contesto digitale in continua evoluzione.

Competizione e adattamento

Con un panorama tecnologico sempre più competitivo, OpenAI affronta sfide significative, inclusa la proliferazione di sistemi di intelligenza artificiale open-source. Questo accerchiamento richiede non solo un miglioramento continuo dei propri servizi, ma anche una riprogettazione delle politiche di utilizzo, al fine di garantire che gli utenti possano continuare a fidarsi della piattaforma. La pressione competitiva spinge OpenAI ad innovare sempre più in fretta, mantenendo la sicurezza come priorità fondamentale.

Conclusioni sui vantaggi delle tecnologie OpenAI

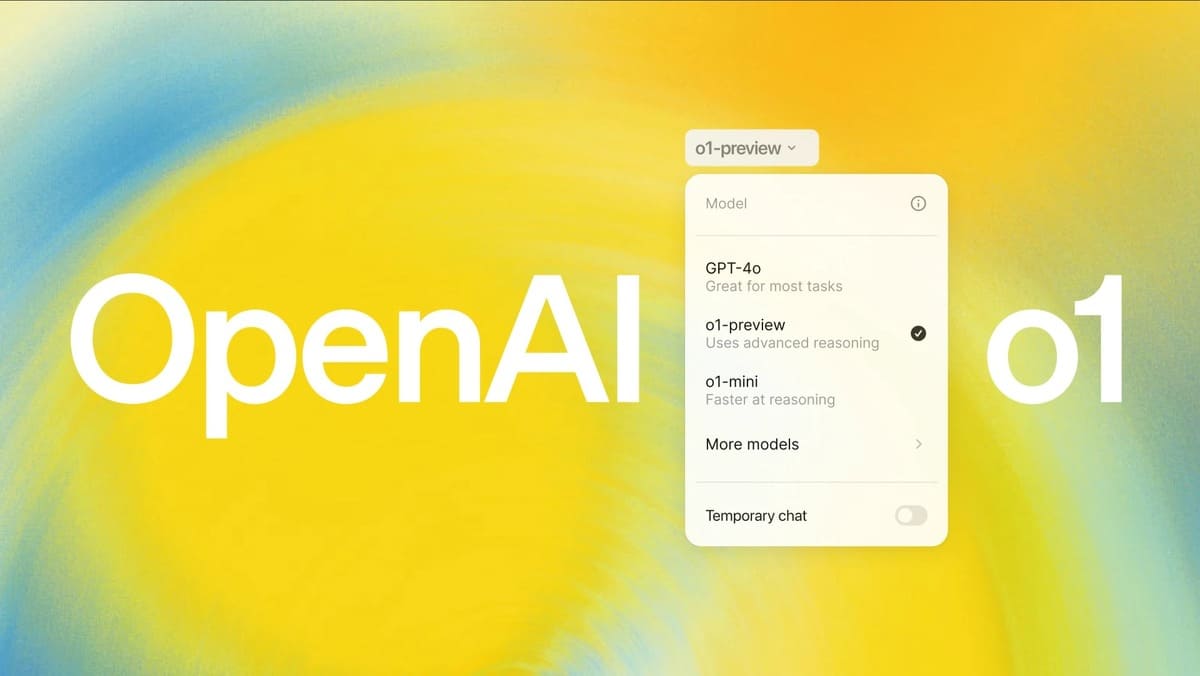

Nonostante le sfide, i benefici delle tecnologie OpenAI sono evidenti in molteplici campi, dalle banche alla sanità. L’integrazione di modelli avanzati come GPT-4 e il loro utilizzo all’interno del servizio Azure OpenAI dimostrano come l’innovazione possa essere applicata in modo sicuro e responsabile.

Misure di Sicurezza di OpenAI

| Aspetto | Descrizione |

| Feedback Esterno | Integrazione dei suggerimenti di esperti per migliorare le politiche di sicurezza. |

| Privacy | Politiche rigorose per proteggere i dati personali degli utenti. |

| Governance Indipendente | Comitato per la sicurezza autonomo dal consiglio di amministrazione. |

| Formazione Continua | Assicurare che i modelli di intelligenza artificiale siano costantemente aggiornati. |

| Conformità Normativa | Adempimento delle normative vigenti come l’AI ACT per garantire la legalità. |

| Trasparenza | Impegni per migliorare la chiarezza sull’uso dei dati e delle tecnologie. |

| Rischi Potenziali | Identificazione dei pericoli associati all’uso delle tecnologie OpenAI. |

| Collaborazioni | Cooperazione con altre entità per affrontare problematiche di sicurezza. |

OpenAI ha intrapreso un impegno significativo verso la sicurezza digitale in risposta ai rischi associati all’uso della sua tecnologia. Il lancio di GPT-4 rappresenta una sfida, ma l’organizzazione ha prontamente implementato misure di sicurezza elaborate grazie al contributo di esperti esterni in vari settori. Questo approccio proattivo dimostra una consapevolezza dei potenziali rischi e la volontà di affrontarli efficacemente.

Le politiche di utilizzo sono un elemento cruciale nel garantire che gli utenti della piattaforma rispettino pratiche sicure e responsabili. OpenAI sottolinea l’importanza di non compromettere la privacy degli altri, stabilendo regole chiare su comportamenti inaccettabili, come l’assistenza o l’esecuzione di attività che violano i diritti altrui.

Durante il processo di addestramento del nuovo modello, un comitato dedicato alla sicurezza è attivamente coinvolto nell’ottimizzazione delle politiche e dei processi. Questo impegno continuo è essenziale per affinare i protocolli di sicurezza e rispondere a eventuali vulnerabilità emerse. In questo contesto, OpenAI cerca di mantenere un’equa rete di protezione per gli utenti e il loro accesso alla tecnologia.

In un contesto competitivo in rapida evoluzione, OpenAI è sempre più in contatto con una crescente varietà di sistemi di intelligenza artificiale che offrono alternative accessibili come le soluzioni open-source. Questo accerchiamento ha spinto OpenAI a investire ulteriormente nella trasparenza e nell’adeguamento alle normative vigenti, come l’AI ACT. Tali misure non solo aiutano a garantire la sicurezza dei dati, ma facilitano anche la conformità a leggi e regolamenti in continua evoluzione.

In aggiunta, l’attenzione di OpenAI nella gestione dei dati personali si evidenzia attraverso l’impegno di migliorare la trasparenza. Recenti rapporti indicano che OpenAI ha fornito chiarimenti ai regolatori riguardo all’uso dei dati personali, creando così un dialogo più aperto e costruttivo con le autorità per migliorare la fiducia degli utenti nei suoi servizi.

Le misure di sicurezza adottate non solo riflettono la serietà con cui OpenAI affronta la sua responsabilità sociale, ma evidenziano anche la necessità di una governance indipendente per proteggere il sistema da potenziali minacce. Questo approccio multistrato assicura non solo la protezione immediate, ma contribuisce anche a sviluppare un ecosistema di intelligenza artificiale più sicuro per il futuro.

OpenAI ha compreso che la sfida della sicurezza digitale è fondamentale per il successo e la fiducia degli utenti nei suoi prodotti. Con l’introduzione di GPT-4, l’azienda ha attuato una serie di misure per mitigare i rischi associati all’uso della sua intelligenza artificiale. Questi interventi di sicurezza si basano su feedback provenienti da esperti esterni di vari ambiti, garantendo una valutazione diversificata e competente delle potenziali vulnerabilità.

Una delle politiche chiave adottate da OpenAI è il rafforzamento della trasparenza riguardo all’uso dei dati personali. L’azienda si è composta un impegno a rispettare le normative vigenti, come l’AI ACT, al fine di migliorare la conformità legale e la protezione della privacy degli utenti. Questo non solo contribuisce a una maggiore sicurezza dei dati, ma rafforza anche la fiducia degli utenti nei servizi offerti.

Inoltre, OpenAI ha stabilito un comitato per la sicurezza che opera con un approccio indipendente dal consiglio di amministrazione. Tale organismo ha individuato cinque aree chiave per garantire governance e protezione efficaci, contribuendo così a una gestione responsabile della tecnologia. Mentre l’azienda si dedica all’addestramento di nuovi modelli, l’attenzione si concentra anche sull’affinamento continuo delle politiche e dei processi di sicurezza.

In un contesto competitivo, dove concorrenti emergenti offrono soluzioni open-source, OpenAI è impegnata a mantenere un alto standard di sicurezza e affidabilità. Le innovazioni, come il servizio Azure OpenAI, dimostrano l’intenzione di espandere la capacità di utilizzo della sua AI in settori critici come quello bancario e assicurativo, richiedendo sempre più rigorose misure di sicurezza e protezione dei dati.

Domande Frequenti su Come OpenAI Assicura la Sicurezza della Sua Tecnologia

Quali sono le principali sfide per la sicurezza digitale di OpenAI? OpenAI affronta vari rischi legati alla tecnologia e lavora costantemente per implementare misure che garantiscano la sicurezza dei dati e l’affidabilità dei suoi sistemi.

Come vengono implementati i protocolli di sicurezza? OpenAI ha riconosciuto i rischi e ha adottato interventi di sicurezza basati su feedback di esperti esterni, rafforzando così le proprie politiche di utilizzo.

Qual è l’impatto delle politiche di utilizzo? Queste politiche mirano a non compromettere la privacy degli utenti e a prevenire comportamenti scorretti, garantendo un utilizzo responsabile della tecnologia.

Come si sviluppano i nuovi modelli di intelligenza artificiale? Durante la fase di addestramento dei nuovi modelli, il comitato per la sicurezza di OpenAI è impegnato a perfezionare le politiche e i processi per garantire una maggiore sicurezza.

Qual è la posizione di OpenAI in un mercato competitivo? OpenAI si trova ad affrontare la crescente concorrenza di modelli di intelligenza artificiale open-source ma continua a lavorare per mantenere un alto livello di affidabilità e sicurezza.

Quali norme seguono i sistemi OpenAI? OpenAI si impegna a conformarsi alle normative vigenti, come l’AI ACT, per garantire una maggiore sicurezza dei dati.

Come si sta adoperando OpenAI per la trasparenza? Attraverso meccanismi di trasparenza, OpenAI si impegna a utilizzare i dati personali in modo responsabile e a fornire chiarimenti al Garante.

Qual è il ruolo del comitato per la sicurezza? Questo organismo lavora in modo indipendente dal Cda per stabilire una governance sicura e proteggere i dati degli utenti.

Come gestisce OpenAI le questioni etiche relative all’AI? OpenAI presta particolare attenzione alle considerazioni etiche, assicurando che le sue tecnologie vengano sviluppate e implementate in modo responsabile.

Quali sono i principali benefici delle tecnologie OpenAI? Le tecnologie OpenAI offrono soluzioni avanzate e sicure che possono essere utilizzate in vari ambiti, garantendo miglioramenti significativi nell’efficienza operativa.