OpenAI ha adottato un approccio proattivo alla trasparenza dei dati, riconoscendo l’importanza di informare gli utenti sulle modalità di utilizzo delle proprie informazioni personali. Collaborando con autorità regolatorie, come il Garante privacy, l’azienda si impegna a rispettare le normative vigenti, come il GDPR. Attraverso la pubblicazione di nuove politiche sulla privacy e modifiche ai termini d’uso, OpenAI sta cercando di garantire una maggiore chiarezza riguardo al trattamento dei dati degli utenti e alle pratiche di intelligenza artificiale associate. L’obiettivo è costruire un rapporto di fiducia con gli utenti, assicurando che le loro informazioni siano gestite in modo etico e responsabile.

|

IN BREVE

|

- Collaborazione con il Garante Privacy – OpenAI lavora per garantire il rispetto delle normative sulla privacy.

- Politiche aggiornate sulla privacy – Introduzione di nuove policy per una maggiore chiarezza nella gestione dei dati.

- Divulgazione dei dati – OpenAI fornisce informazioni dettagliate su come vengono utilizzati i dati degli utenti.

- Esperimenti con modelli recenti – Utilizzo di GPT-4 per migliorare la trasparenza nel funzionamento dell’IA.

- Accesso aperto ai documenti – Promessa di rendere i documenti ufficiali consultabili da tutti.

- Infrastruttura di sicurezza – Implementazione di misure di sicurezza per proteggere i dati degli utenti.

- Feedback degli utenti – Apertura a critiche e suggerimenti per migliorare la trasparenza.

OpenAI ha adottato un approccio خاص per garantire la trasparenza nell’uso dei dati degli utenti. Attraverso varie iniziative e collaborazioni, l’azienda mira a garantire che gli utenti siano informati su come i loro dati vengano utilizzati e protetti. In questo articolo, esploreremo i principali aspetti della trasparenza dei dati in OpenAI, compresi le recenti modifiche alle privacy policy, la cooperazione con le autorità competenti e le pratiche di sicurezza implementate.

Modifiche alle privacy policy e ai termini d’uso

Recentemente, OpenAI ha aggiornato le proprie privacy policy e i termini d’uso al fine di implementare una politica di maggiore trasparenza. Questa modifica mira a chiarire come i dati degli utenti vengano raccolti, utilizzati e condivisi. OpenAI ha riconosciuto l’importanza di informare gli utenti e ha fatto un passo significativo per migliorare la comunicazione riguardo all’uso dei loro dati, rispondendo così alle critiche ricevute in passato.

Collaborazione con il Garante privacy

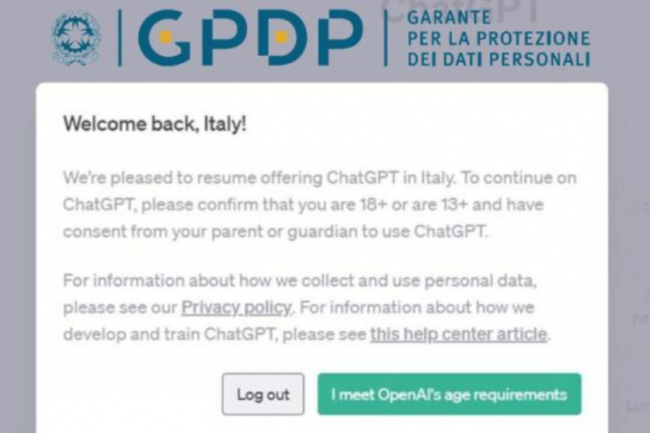

In un tentativo di risolvere il blocco di ChatGPT e affrontare le preoccupazioni relative ai dati, OpenAI ha avviato una cooperazione attiva con il Garante privacy. Questo accordo si concentra sul rispetto del GDPR e su come OpenAI può rimanere conforme alle normative sulla protezione dei dati. La collaborazione mira a migliorare la fiducia degli utenti, fornendo garanzie sui diritti e sulle protezioni relativi ai dati personali.

Impegno per la trasparenza nelle pratiche aziendali

OpenAI sta affinando le proprie soluzioni per aderire meglio alle esigenze degli utenti e degli sviluppatori. Questa specializzazione nei servizi implica un impegno costante verso la trasparenza. L’azienda non solo cerca di ottimizzare i propri prodotti, come GPT-4, ma si sforza anche di rendere disponibili informazioni dettagliate sui dati e sui modelli utilizzati per il training dell’AI. OpenAI continua a lavorare su come divulgare ulteriori dettagli sull’uso dei dati e sulle tecniche adottate per garantire la privacy degli utenti.

Le sfide della trasparenza nella tecnologia AI

Nonostante gli sforzi per aumentare la trasparenza, OpenAI affronta diverse sfide. Ci sono critiche riguardo alla reale trasparenza delle informazioni fornite, con richieste di divulgare chiaramente quali dati vengono utilizzati per addestrare i modelli e in che modo questi dati vengono gestiti. Inoltre, l’innovazione tecnologica continua ad evolversi rapidamente, il che rende difficile mantenere aggiornate le politiche di trasparenza e di sicurezza dei dati. OpenAI deve continuamente adattarsi a queste sfide per garantire un alto livello di fiducia degli utenti.

Conclusioni sull’approccio di OpenAI alla trasparenza dei dati

Nel complesso, l’approccio di OpenAI alla trasparenza dei dati include una combinazione di modifiche alle privacy policy, collaborazioni con le autorità competenti, e l’impegno a migliorare le pratiche aziendali. Mentre l’azienda affronta le sfide inerenti alla trasparenza, il suo obiettivo rimane quello di costruire una relazione di fiducia con gli utenti e di garantire che i loro dati siano gestiti in modo responsabile e trasparente. Visita i seguenti link per approfondire l’argomento: Trasparenza nell’intelligenza artificiale: OpenAI e Meta a confronto, OpenAI, la sua funzionalità e il funzionamento dei modelli AI, e Garante Privacy vs OpenAI.

Approccio alla Trasparenza dei Dati di OpenAI

| Aspetto | Descrizione |

| Politiche di Privacy | OpenAI ha introdotto nuove privacy policy e termini d’uso per migliorare la chiarezza sull’uso dei dati. |

| Collaborazione con Autorità | OpenAI collabora con il Garante della privacy per rispettare GDPR e le normative locali. |

| Trasparenza Operativa | L’azienda si è impegnata a rendere le informazioni sui dati degli utenti più accessibili. |

| Gestione dei Dati | Le pratiche di gestione dei dati personali sono state rafforzate per garantire una base legale per l’uso dei dati. |

| Risposta alle Critiche | OpenAI ha affrontato critiche riguardanti la mancanza di trasparenza, intraprendendo cambiamenti proattivi. |

| Infrastruttura di Sicurezza | Un approccio completa alla sicurezza è in atto per proteggere i dati sensibili degli utenti. |

| Accesso ai Documenti | OpenAI ha promesso che i documenti ufficiali saranno sempre consultabili per favorire la trasparenza. |

| Innovazione e Governance | L’innovazione tecnologica richiede una governance trasparente e responsabile nel settore dell’AI. |

L’approccio di OpenAI alla trasparenza dei dati

OpenAI sta attuando un approccio collaborativo con il Garante Privacy per affrontare le questioni relative alla trasparenza nell’uso dei dati. Questa cooperazione ha come obiettivo principale il rispetto del GDPR, norme fondamentali per la protezione dei dati personali. La società ha riconosciuto le critiche ricevute in merito alla mancanza di comunicazione sui modi in cui i dati degli utenti venivano gestiti. Attraverso questo intervento, OpenAI si impegna a fornire informazioni più chiare sui diritti degli utenti e sull’utilizzo dei loro dati.

Recentemente, OpenAI ha messo in atto una politica di trasparenza più robusta, modificando i suoi termini di servizio per chiarire come vengono trattati i dati personali. Queste modifiche mirano a migliorare la fiducia degli utenti e a garantire che siano consapevoli del trattamento delle loro informazioni. Il dialogo con gli utenti è diventato un elemento centrale nella strategia dell’azienda, mirando ad una comunicazione più aperta e comprensibile.

Inoltre, con il lancio di modelli avanzati come GPT-4, OpenAI ha espresso il desiderio di affinare i propri servizi in modo da rispondere meglio alle esigenze di privacy degli utenti. Questo implica una revisione continua delle pratiche aziendali per garantire che rispondano ai requisiti legali e alle aspettative del pubblico. La trasparenza, quindi, non è solo una questione di conformità, ma un aspetto fondamentale per costruire un rapporto di fiducia con gli utilizzatori.

La società ha intrapreso anche sforzi per divulgare informazioni relative alla sicurezza dei dati, presentando un approccio ben strutturato per la protezione delle informazioni degli utenti. Con l’intento di alleviare le preoccupazioni intorno alla privacy, OpenAI sta rendendo disponibili dettagli sulle misure di sicurezza e sui protocolli utilizzati nel trattamento dei dati. Questo segnale di apertura è un passo significativo verso una maggiore responsabilità e chiarezza nel campo dell’intelligenza artificiale.

L’approccio di OpenAI alla trasparenza dei dati

OpenAI ha adottato un approccio strategico e mirato per garantire la trasparenza nella gestione dei dati, soprattutto in un panorama sempre più attento alla privacy degli utenti. Attraverso la collaborazione con il Garante privacy, l’organizzazione ha fatto significativi progressi per allinearsi con le normative del GDPR e rispondere alle preoccupazioni riguardanti la privacy.

Un aspetto fondamentale di questo approccio è la ristrutturazione delle politiche relative alla privacy e ai termini d’uso, mirata a migliorare la chiarezza e a garantire che gli utenti siano adeguatamente informati su come i loro dati vengono utilizzati. OpenAI ha riconosciuto l’importanza di fornire informazioni più dettagliate sull’uso dei dati personali, rispondendo così alle critiche ricevute da diverse autorità e da esperti del settore.

Per garantire una maggiore trasparenza, OpenAI sta anche migliorando la sua comunicazione verso il pubblico, pubblicando dettagliativi sull’infrastruttura di sicurezza e sulle misure adottate per proteggere i dati degli utenti. Ciò include la divulgazione di informazioni sui dati utilizzati per l’addestramento dei modelli, che è cruciale per comprendere il funzionamento dell’intelligenza artificiale.

Tuttavia, nonostante questi sforzi, emerge una certa tensione riguardo alla trasparenza. Mentre OpenAI continua a sviluppare tecnologie avanzate come il GPT-4, vi è il timore che la complessità di queste soluzioni possa compromettere la chiarezza delle informazioni fornite agli utenti. Pertanto, l’obiettivo rimane quello di bilanciare l’innovazione tecnologica con la necessità di garantire un accesso equo e trasparente ai dati.

Domande Frequenti sulla Trasparenza dei Dati di OpenAI

Qual è l’approccio di OpenAI alla trasparenza dei dati? OpenAI si impegna a migliorare la trasparenza nella gestione dei dati degli utenti, collaborando con autorità di regolamentazione come il Garante privacy per garantire il rispetto delle normative, come il GDPR.

Come OpenAI gestisce i dati personali degli utenti? OpenAI divulga informazioni dettagliate su come i dati vengono utilizzati, promuovendo pratiche etiche e garantendo che gli utenti siano informati sui processi che riguardano i loro dati.

Quali misure di sicurezza sono implementate da OpenAI? OpenAI ha sviluppato un’infrastruttura di sicurezza ben articolata nel tentativo di proteggere i dati personali degli utenti attraverso varie strategie e tecnologie avanzate.

OpenAI è stata criticata per la gestione dei dati? Sì, l’azienda ha affrontato critiche da parte di autorità come il Garante privacy per non aver informato adeguatamente gli utenti sull’uso dei loro dati e per la mancanza di chiarezza nella base legale delle norme.

OpenAI offre risorse informative agli utenti? OpenAI ha migliorato la propria documentazione ufficiale per garantire che le informazioni siano facilmente accessibili a tutti, come parte del suo impegno verso la trasparenza.

Cosa si prevede per il futuro della trasparenza dei dati in OpenAI? OpenAI continuerà a evolversi e a migliorare le proprie pratiche di trasparenza e sicurezza, adattandosi alle nuove sfide e necessità normative nel campo dell’intelligenza artificiale.